En los últimos años, la inteligencia artificial ha experimentado un notable avance, dejando atrás sus inicios en la generación de imágenes a partir de texto para adentrarse en el mundo de los vídeos. Herramientas como Sora han contribuido a potenciar la capacidad de la IA generativa, permitiendo la creación de contenido visual en movimiento a partir de elementos estáticos como fotos y fragmentos de audio.

Tabla de contenido

Microsoft y su impresionante herramienta de generación de videos

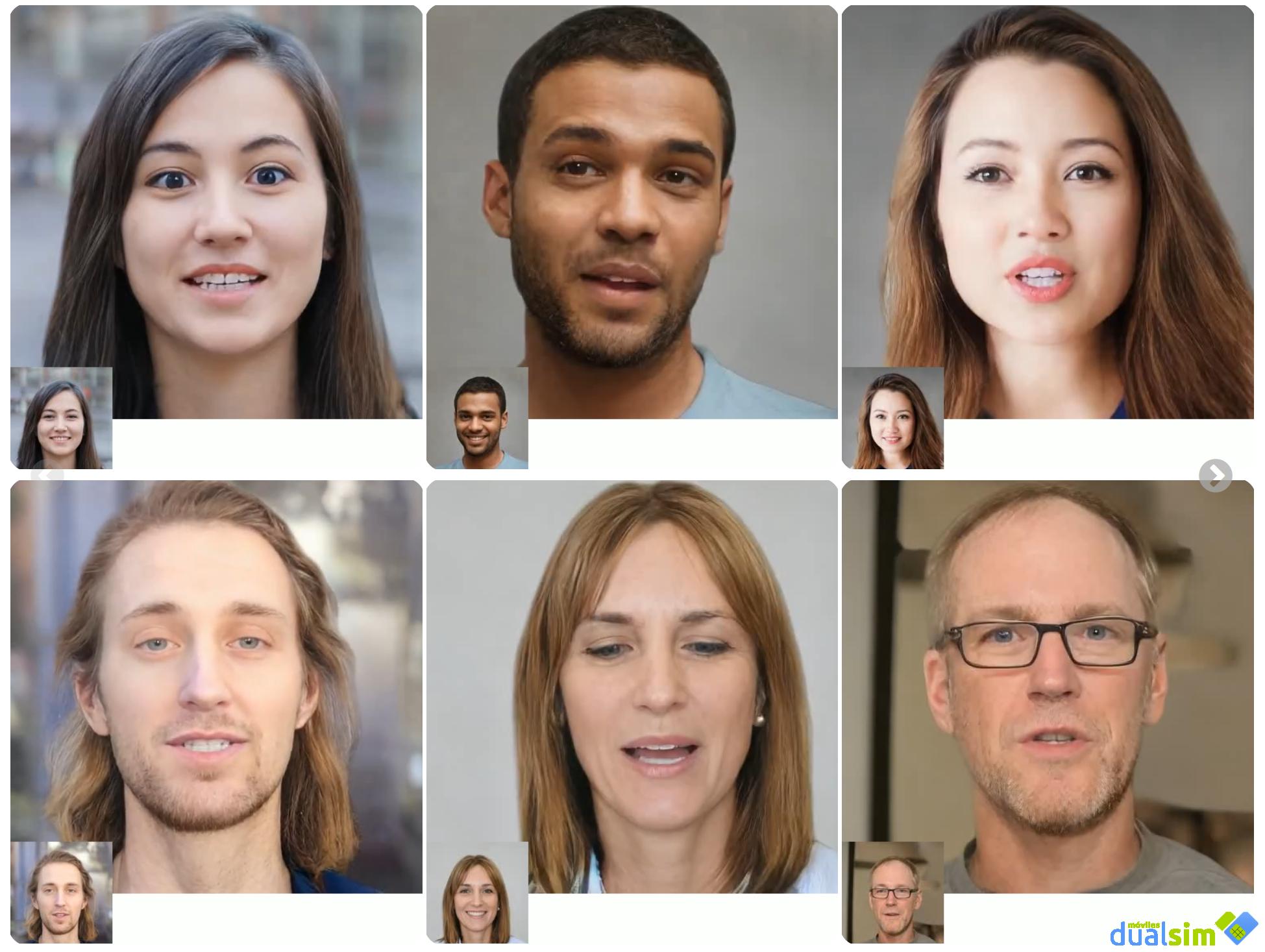

Recientemente, Microsoft ha presentado VASA-1, un modelo de IA de imagen-a-vídeo que ha revolucionado el campo de la generación audiovisual. Esta innovadora tecnología es capaz de crear vídeos realistas a partir de una sola foto y un fragmento de audio de voz, incorporando movimientos faciales y labiales sincronizados para lograr una percepción de naturalidad, autenticidad y vivacidad en el contenido generado.

Según explicaciones proporcionadas por Microsoft, VASA-1 opera a través de un modelo de generación de dinámicas faciales y movimientos de cabeza holístico, que trabaja en un espacio latente de rostro para lograr resultados expresivos y detallados. Gracias a este enfoque innovador, la herramienta es capaz de superar a sus predecesores en términos de calidad y realismo en la generación de vídeos, abriendo la puerta a futuras interacciones en tiempo real con avatares realistas que emulan comportamientos humanos.

Ejemplos de lo que puede lograrse con VASA-1

Los avances y limitaciones de VASA-1

A pesar de su potencial y capacidades, es importante tener en cuenta que VASA-1 es una herramienta de demostración de investigación, sin planes inmediatos de lanzamiento como producto comercial o API. Microsoft ha enfatizado que la tecnología aún se encuentra en fase experimental y que no tiene previsto ponerla a disposición del público en un futuro cercano, probablemente como medida para mitigar posibles preocupaciones respecto al uso de vídeos deepfake generados por esta tecnología.

Deja una respuesta